Private AI als Antwort auf verschärfte Datenschutzanforderungen

Zum Safer Internet Day 2026 rückt die verantwortungsvolle Nutzung von künstlicher Intelligenz in den Fokus. Während die Bedrohungslage sich laut Stanford AI Index Report um über 56 Prozent verschärft hat, müssen Unternehmen gleichzeitig DSGVO und EU AI Act einhalten. Private AI bietet einen Lösungsansatz, bei dem sensible Daten die Unternehmensumgebung niemals verlassen.

Die Diskussion rund um den Safer Internet Day hat sich in den letzten Jahren grundlegend gewandelt. Statt individueller Passworthygiene stehen 2026 umfassendere Themen wie die Regulierung künstlicher Intelligenz im Mittelpunkt. In Deutschland verschärfen die DSGVO und der EU AI Act die Anforderungen an den Umgang mit KI-Systemen deutlich. Gleichzeitig versuchen Unternehmen, mit dem Fortschritt der KI mitzuhalten und verstärkt datengetrieben zu agieren.

Daten bilden die Grundlage der KI-Nutzung, besonders wenn Unternehmen über grosse Mengen an Verbraucherinformationen verfügen. Das spiegelt sich laut einer Cloudera-Umfrage in der Datenkultur wider: In Deutschland stieg der Anteil der Befragten, die ihre Unternehmenskultur als «extrem datengetrieben» einordnen, von acht Prozent (2024) auf 30 Prozent (2025).

Volatile Bedrohungslage und geopolitische Spannungen

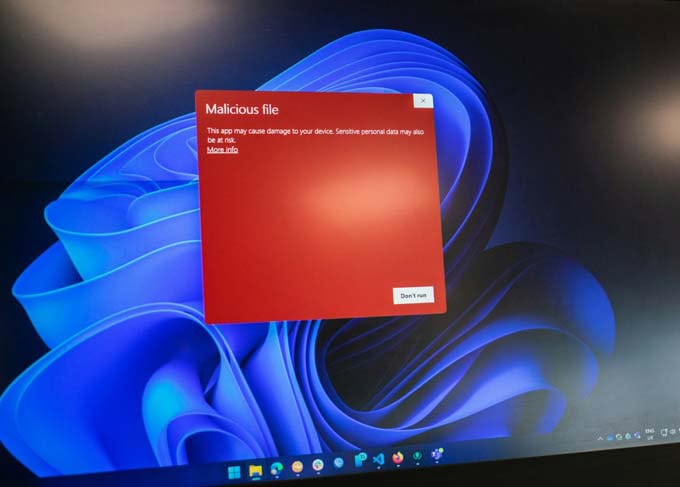

Die Dringlichkeit, Datenschutz als Teil von KI-Strategien mitzudenken, ergibt sich aus einer volatilen Bedrohungslage und geopolitischen Spannungen. Die zunehmende Nutzung von KI in verschiedenen Unternehmensbereichen erhöht die Angriffsfläche für Cyberbedrohungen. Der Stanford AI Index Report 2025 dokumentiert einen Anstieg der Sicherheits- und Datenschutzvorfälle im KI-Umfeld um mehr als 56 Prozent innerhalb eines Jahres.

Besonders im Fokus der Cyberkriminellen stehen weiterhin Verbraucherdaten: Im Bericht «Cost of a Data Breach» von IBM waren sie weltweit der am häufigsten kompromittierte Datentyp und tauchten in 53 Prozent aller Datenschutzverletzungen im Einzelhandel auf. Die gehäuften Cyberbedrohungen richten sich auf die grossen Transaktionsvolumina und die sensiblen persönlichen Daten, die Einzelhändler und Finanzinstitute verwalten.

Zudem ist das Bewusstsein der Verbraucher für den Wert ihrer Daten gestiegen, wie die Cisco 2026 Data Privacy Benchmark Studie zeigt. Demnach geben 46 Prozent der globalen Unternehmen an, dass eine klare Kommunikation darüber, wie die KI mit Verbraucherdaten trainiert wird, essenziell ist. Nur so bleibt das Vertrauen der Nutzer in eine Organisation bestehen.

Private AI überwindet das Datenschutzdilemma

Unternehmen müssen die Daten, die ihr Wachstum vorantreiben, verantwortungsbewusst verwalten und schützen, um das Risiko von Datenlecks und unbefugtem Zugriff zu reduzieren. Unter diesen Umständen führt ein einziger Verstoss nicht nur zu Geldstrafen, sondern kann die Reputation und den Markenwert langfristig schädigen. Gleichzeitig gilt es, die Grenzen von KI auszuloten, um sich einen Wettbewerbsvorteil zu verschaffen.

Hier hat sich Private AI als entscheidendes Framework für moderne Unternehmen herauskristallisiert. Dahinter verbirgt sich ein strategischer Ansatz, der festlegt, wie Unternehmen KI-Systeme entwickeln, betreiben und verwalten. Private AI stellt sicher, dass die Input- und Output-Daten von Modellen niemals die Unternehmensumgebung verlassen. Sämtliche Informationen verbleiben innerhalb der eigenen Infrastruktur. So können Unternehmen das «Datenschutzdilemma» überwinden. Private AI widerlegt die Annahme, dass Unternehmen sich zwischen der Nutzung von Daten für Innovationen und deren Sperrung für KI aus Compliance-Gründen entscheiden müssen.

Absolute Sichtbarkeit als Voraussetzung

Eine effektive, private KI erfordert jedoch absolute Sichtbarkeit der Daten. Laut dem Metadatenmanagement-Bericht von Gartner geben fast 60 Prozent der Unternehmen zu, dass sie nicht wissen, wo sich ihre kritischen Daten befinden. Und was man nicht sehen kann, kann man auch nicht kontrollieren. Um dem entgegenzuwirken, nutzen erfolgreiche Unternehmen heute einheitliche Datenplattformen wie die von Cloudera, die eine lückenlose Data-Lineage bieten. Sie verfolgen genau, woher die Daten stammen, wie sie transformiert wurden und wer darauf zugegriffen hat.

Da generative KI-Agenten zunehmend zu einem festen Bestandteil in Arbeitsabläufen werden, muss eine sorgfältige Prüfung der Daten erfolgen, mit denen sie gefüttert werden. Die wertvollsten Daten für die Feinabstimmung der KI – Support-Transkripte und Transaktionshistorien – gehören häufig auch zu den sensibelsten Informationen. So kann Datenschutz und -Sicherheit zum entscheidenden Werttreiber werden. In einer Zeit verschärfter Regulierung und wachsender geopolitischer Unsicherheit werden diejenigen Unternehmen erfolgreich sein, die proaktive Schutzmassnahmen umsetzen und gewährleisten, dass ihre KI privat, kontrolliert und von Grund auf sicher ist.

Mehr Informationen: www.cloudera.com