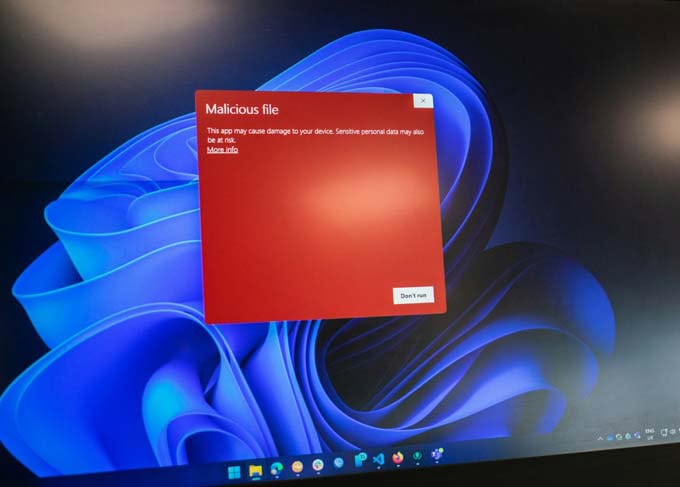

Verstösse gegen Datenrichtlinien mit Generativer KI haben sich verdoppelt

Der neue Netskope Cloud & Threat Report 2026 für die DACH-Region warnt: Während die Nutzung von Generativer KI (GenAI) um das Dreifache steigt, hinkt die Datensicherheit hinterher. «Legacy-Risiken» wie Phishing und Insider-Bedrohungen bleiben kritisch.

Trotz des Versuchs, die KI-Nutzung durch offizielle Unternehmenstools zu kontrollieren, zeigt der jüngst veröffentlichte Cloud and Threat Report 2026 von Netskope Threat Labs eine besorgniserregende Entwicklung: Die Zahl der Verstösse gegen Datensicherheitsrichtlinien im Zusammenhang mit KI-Anwendungen hat sich im Vergleich zum Vorjahr mehr als verdoppelt. So bleibt das Risiko durch Schatten-KI hoch, da Mitarbeiter weiterhin massiv sensible Daten in ungeschützte Kanäle einspeisen. Der Netskope Cloud and Threat Report 2026 basiert auf anonymisierten Daten, die weltweit über die Netskope Security Cloud Plattform erhoben wurden. Er analysiert Trends in der Cloud-Nutzung, KI-Adoption und der globalen Bedrohungslandschaft.

KI-Boom überholt Sicherheitsmassnahmen

Der Bericht zeigt ein explosives Wachstum. Während sich die Zahl der Nutzer von SaaS-GenAI-Anwendungen im vergangenen Jahr verdreifachte, erhöhte sich die Intensität der Nutzung drastisch. So stieg die Anzahl der gesendeten Prompts um das Sechsfache. Als besonders kritisch anzusehen ist: Trotz verstärkter Bemühungen der IT-Abteilungen nutzen weiterhin 47 % der Anwender private KI-Accounts für geschäftliche Zwecke. Durch diese Schatten-KI registrieren Unternehmen durchschnittlich 223 Vorfälle pro Monat, bei denen sensible Daten an KI-Apps gesendet wurden. Beim oberen Viertel (25 %) der untersuchten Firmen sind es sogar über 2100 Vorfälle monatlich.

Als weitere relevante Ergebnisse zeigt der Report:

- Gemini ist auf der Überholspur: Google Gemini verzeichnete ein massives Wachstum. So stieg die Nutzungsrate von 46 % auf 69 %. Netskope prognostiziert, dass Gemini im ersten Halbjahr 2026 ChatGPT als meistgenutzte KI-Plattform in Unternehmen ablösen wird.

- Gefährliche Datenlecks: Quellcode (42 %), regulierte Daten (32 %) und geistiges Eigentum (16 %) sind die am häufigsten in KI-Tools hochgeladenen sensiblen Informationen.

- Insider-Risiko «Persönliche Apps»: 60 % aller Insider-Bedrohungen stehen im Zusammenhang mit der Nutzung privater Cloud-Instanzen (wie Google Drive oder OneDrive), wobei die Nutzung von GenAI-Tools dieses Risiko massiv verstärkt. Besonders besorgniserregend: 54 % der Verstösse gegen Datenrichtlinien betreffen regulierte Daten (Finanz-, Gesundheits- oder Personaldaten).

Agentic AI und MCP

Für das Jahr 2026 warnt Netskope vor der zunehmenden Komplexität durch Agentic AI. Dabei handelt es sich um KI-Systeme, die autonom komplexe Aufgaben über verschiedene Unternehmensressourcen hinweg ausführen. «Agentic AI schafft eine völlig neue Angriffsfläche», so Ray Canzanese, Director der Netskope Threat Labs. «Wenn autonome Agenten Zugriff auf interne Daten erhalten, können Fehlkonfigurationen oder bösartige Prompts zu massiven Datenabflüssen in Millisekunden führen.» Auch der Trend zu KI-gesteuerten Browsern und dem Model Context Protocol (MCP) wird als kritisches Sicherheitsrisiko für 2026 eingestuft.

Handlungsempfehlungen

Der Report empfiehlt Unternehmen einen vierstufigen Schutz:

- Vollständige Inspektion: Überprüfung des gesamten HTTP/HTTPS-Verkehrs, inklusive KI-Traffic.

- App-Governance: Blockieren von risikoreichen Tools ohne Geschäftszweck (z. B. ZeroGPT, DeepSeek).

- DLP-Fokus: Einsatz von Data Loss Prevention, um Quellcode und Passwörter vor dem Abfluss in KI-Modelle zu schützen.

- Isolation: Nutzung von Remote Browser Isolation (RBI) für riskante oder neue Domains.

Quelle: Netskope